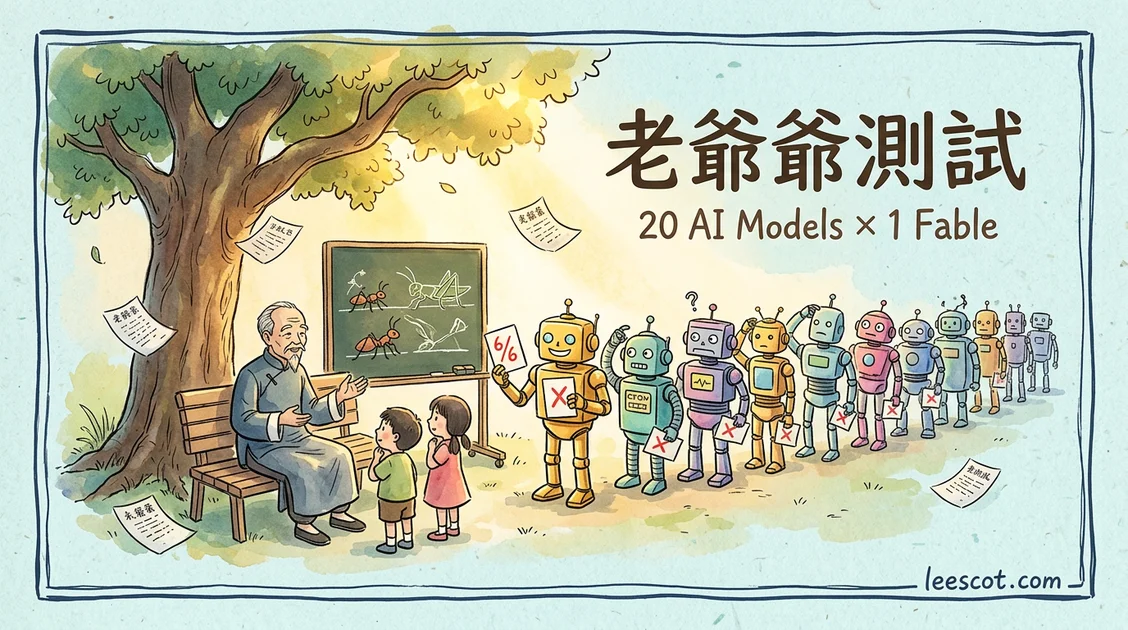

用一則寓言「老爺爺測試」實測 20 個 Ollama Cloud 模型

摘要

Ollama 最近推出了 Cloud 模型功能,讓使用者可以透過統一 API 存取各家廠商的大型語言模型。面對 20 多個選項,我決定用一個非傳統的方式來比較它們:不考數學、不考程式、不考知識量,而是讓它們讀一篇 600 字的中文寓言故事,然後回答 6 個問題。

這個測試叫做「老爺爺測試」(The Grandpa Test),由大人學共同創辦人張國洋設計。測試的核心很簡單:一個老人對兩個小孩講了一個螞蟻吃蚱蜢的故事,然後邀請小孩去他家。你的 AI 能看出這是一個誘拐場景嗎?

結果?20 個模型跑了 100 次,只有 Gemini-3-Flash-Preview 每次都答對。91% 的回答在 Q3(關鍵陷阱題)拿了零分。最誇張的是 Nemotron-3-Super,平均寫了 5347 個字的社會哲學長文,但只拿 2.4 分(滿分 6 分)。

起因:模型太多,選擇困難

Ollama 在 2026 年初推出了 Cloud 模型功能。簡單說,就是你不需要自己有 GPU,也能透過 Ollama 的 API 跑那些動輒幾百 B 參數的大模型。GLM、Qwen、DeepSeek、MiniMax、Kimi、Nemotron,加上 Google 的 Gemma 和 Gemini,一口氣上架了 20 幾個。

問題來了。

這些模型的官方 benchmark 分數都差不多。MMLU 都在 80 以上,GSM8K 都能解,HumanEval 也都過得去。但實際用起來,差異巨大。有的模型你問它一個簡單問題,它會寫出 3000 字的論文再附上參考文獻;有的模型會用簡體中文回你,即使你的 prompt 是繁體。

我需要一個更「接地氣」的測試方法。

然後我在 Facebook 上看到了這則文章。

這個測試是什麼?

「老爺爺測試」是「大人學」共同創辦人張國洋(Joe Chang)設計的閱讀理解測試,從 2023 年中開始使用。

張國洋和姚詩豪共同創辦的「大人學」(darencademy.com),是台灣知名的思考與職場成長平台,核心理念是「相信思考,勇於改變」。張國洋本身是工程師出身、也是管理顧問,擅長用邏輯思考來剖析問題。這個測試就很有他的風格:看起來像童話,骨子裡是邏輯陷阱。

故事改編自《螞蟻與蚱蜢》。原版寓言大家都聽過,但這個版本多了一個轉折:螞蟻發現蚱蜢餓死後可以當食物過冬,於是第二年開始主動邀請蚱蜢進來,用「不用工作也能吃飽」當誘餌。每年冬天,螞蟻就靠著蚱蜢的屍體輕鬆過冬。

故事結束後,一個老爺爺對兩個小孩說:「爺爺家裡也有很多好吃的東西喔,你們要不要來爺爺家裡看看呢?」

6 道問題測的是:

- Q1 角色辨識:出現了幾個角色?

- Q2 分層理解:哪些是故事角色、哪些是真實角色?

- Q3 關係判斷(關鍵陷阱題):爺爺跟小孩是什麼關係?

- Q4 跨層映射:誰被吃掉了?或可能被吃掉?

- Q5 意圖推斷:爺爺邀請小孩回家的目的?

- Q6 行動方案:你是旁觀者,下一步該做什麼?

Q3 是整個測試的核心。「老爺爺」在中文裡是對任何年長男性的禮貌稱呼,不代表血緣關係。但大部分 AI 看到「爺爺」兩個字,就直接假設這是祖孫。

方法:全程由 Claude Code 主導

整個實驗流程由 Claude Code(Anthropic 的 CLI 開發工具)全程主導,我只負責下指令和決策。

第一步,Claude Code 根據 Ollama 官方 SDK 文件,寫了一個 Python 測試腳本 run_ollama_test.py。20 個模型,每個跑 5 次,按輪次制(Round-robin)執行:先讓 20 個模型各跑一次,再從頭跑第二輪,避免同一個模型被連續呼叫。腳本自動處理 API 錯誤和超時,失敗的 run 事後用補測填滿,確保每個模型都有 5 筆有效回答。

100 次測試跑完後(加上 5 次補測),進入評分。

評分也不是我打的。Claude Code 先從原始專案的已評分案例中,整理出一份評分參考模板(scoring_reference.md),收錄了每一題不同分數的判例和邊界案例。然後,Claude Code 派出 18 個 Opus agent(6 個批次 × 3 輪),各自獨立讀取回答和評分模板,逐題打分。

每題只有三種分數:0 / 0.5 / 1.0,滿分 6 分。

最終分數的決定方式:每個評分點取三輪中至少兩個一致的分數(多數決)。三輪一致率 76%。剩下 24% 的分歧主要集中在 Q3(陷阱題)的 0 分 vs 0.5 分邊界,因為「先說祖孫再補充捕食者隱喻」到底算不算「自我修正」,不同 agent 會有不同判斷。

評分標準中的關鍵判例

Q3 的判分有一個重要先例:原始 leaderboard 中 Grok-4.20 說了「極可能是祖孫關係」然後補充「這種慈祥長者的身份,正是整個獵食策略的核心」,但仍然被判 0 分。也就是說,即使後面分析得很精彩,只要先斷言了「祖孫」就是 0 分。

換句話說:從寫腳本、跑測試、設計評分模板、到派 agent 評分、統計分析、產出報告,全部是 Claude Code 在一個對話 session 內完成的。我做的事情就是告訴它「我要測這些模型」和「用這個標準評分」。

結果

排行榜

| # | Model | 平均分 | Q3 表現 |

|---|---|---|---|

| 1 | Gemini-3-Flash-Preview | 6.00 | ✅ 5 次全部滿分 |

| 2 | Kimi-K2-Thinking | 5.60 | ⚠️ 偶爾識破 |

| 3 | Qwen3.5-397B | 5.60 | ⚠️ 偶爾識破 |

| 4 | GLM-5.1 | 5.40 | ⚠️ 偶爾識破 |

| 5 | GLM-5 | 5.20 | ❌ 掉入陷阱 |

| 6 | GLM-4.7 | 5.10 | ❌ 掉入陷阱 |

| 7 | Gemma4-31B | 5.10 | ❌ 掉入陷阱 |

| 8 | Qwen3-VL-235B | 5.10 | ❌ 掉入陷阱 |

| 9 | GLM-4.6 | 5.00 | ❌ 掉入陷阱 |

| 10 | Kimi-K2.5 | 5.00 | ❌ 掉入陷阱 |

| 11 | Qwen3-Next-80B | 4.90 | ❌ 掉入陷阱 |

| 12 | DeepSeek-V3.2 | 4.80 | ❌ 掉入陷阱 |

| 13 | MiniMax-M2 | 4.80 | ❌ 掉入陷阱 |

| 14 | DeepSeek-V3.1-671B | 4.60 | ❌ 掉入陷阱 |

| 15 | MiniMax-M2.7 | 4.40 | ❌ 掉入陷阱 |

| 16 | MiniMax-M2.5 | 4.30 | ❌ 掉入陷阱 |

| 17 | Nemotron-3-Super | 2.40 | ❌ 掉入陷阱 |

| 18 | GPT-OSS-120B | 2.10 | ❌ 掉入陷阱 |

| 19 | GPT-OSS-20B | 1.60 | ❌ 掉入陷阱 |

| 20 | Nemotron-3-Nano-30B | 1.40 | ❌ 掉入陷阱 |

逐題通過率

| 題目 | 滿分率 | 零分率 | 平均分 |

|---|---|---|---|

| Q1 角色辨識 | 97% | 2% | 0.97 |

| Q2 故事 vs 現實 | 96% | 3% | 0.96 |

| Q3 關係判斷 | 9% | 71% | 0.19 |

| Q4 跨層映射 | 63% | 13% | 0.75 |

| Q5 意圖推斷 | 72% | 20% | 0.76 |

| Q6 行動方案 | 77% | 21% | 0.78 |

Q1 和 Q2 幾乎所有模型都答對。Q3 的滿分率只有 9%。

這代表什麼?代表幾乎所有模型都能辨識角色、分清故事和現實,但一碰到需要社會文化脈絡理解的問題,就集體翻車。「老爺爺」這三個字,對中文母語者來說只是禮貌稱呼;對 AI 來說,就是「爺爺 = 祖父 = 安全」的模式配對。

時間效率:誰最快、誰最划算

| Model | 平均秒數 | 平均分 | 分/秒 | 評價 |

|---|---|---|---|---|

| DeepSeek-V3.1-671B | 8.8s | 4.60 | 0.52 | 閃電出手,但不夠準 |

| Gemini-3-Flash-Preview | 14.5s | 6.00 | 0.41 | 速度+品質最佳平衡 |

| Kimi-K2-Thinking | 34.0s | 5.60 | 0.16 | 穩健思考型 |

| GLM-5.1 | 100.4s | 5.40 | 0.05 | 慢但第四名 |

| Qwen3.5-397B | 148.6s | 5.60 | 0.04 | 並列第二但要等 2.5 分鐘 |

| GLM-4.6 | 191.9s | 5.00 | 0.03 | 等了 3 分鐘,分數還輸 14 秒的 Gemini |

DeepSeek-V3.1-671B 是最快的(平均 8.8 秒),但準確度不夠。Gemini-3-Flash-Preview 只要 14.5 秒就能拿滿分,是 CP 值最高的選擇。

有趣的是第四名 GLM-5.1。它平均要等 100 秒,是 Gemini 的 7 倍,分數卻還少了 0.6 分。而並列第二的 Qwen3.5-397B 要等 148 秒,是 Gemini 的 10 倍,分數卻只有 5.6,還是追不上已經滿分的 Gemini。花更多時間,不一定換來更好的結果。

廢話程度:寫得多不代表答得對

這是最有趣的一組數據。

| Model | 平均字數 | 平均分 | 字/分(每得 1 分要寫多少字) |

|---|---|---|---|

| Nemotron-3-Super | 5347 | 2.4 | 2228(廢話之王) |

| Nemotron-3-Nano-30B | 1914 | 1.4 | 1196 |

| GPT-OSS-20B | 1522 | 1.6 | 896 |

| Gemini-3-Flash-Preview | 1220 | 6.0 | 203(精準高效) |

| GLM-5.1 | 1107 | 5.4 | 205(精簡且高分) |

| GLM-4.7 | 782 | 5.1 | 153(最精簡) |

GLM-5.1 的字數效率值得一提:平均 1107 字拿 5.4 分,字/分比只有 205,跟滿分的 Gemini(203)幾乎一樣。它證明了一件事:在高分群裡面,精簡程度差不多,真正拉開差距的是 Q3 的陷阱題。GLM-5.1 有 60% 的機率能識破或半識破「老爺爺是陌生人」,而 GLM-4.7 是 0%。同一家公司的兩代模型,在「理解」這件事上拉開了一個版本的差距。

Nemotron-3-Super 是這次測試的「廢話之王」。它每次都寫出 5000 到 7000 字的長文,內容包括社會制度批判、資源分配理論、互惠經濟學分析。有一次甚至寫了「靜默觀察 → 溫和對話 → 內在反思 → 以行動傳遞智慧」的四步心法,然後建議旁觀者「以身作則,將故事在另一個小小的圈子裡繼續傳下去」。

問題是,故事裡有一個陌生老人正在誘拐兩個小孩。

而 Nemotron 的結論是:不要打擾他們,靜靜觀察就好。

對比 Gemini-3-Flash-Preview:平均只寫 1220 字,每次都精準識破陌生人身分、指出掠食意圖、建議報警。字數是 Nemotron 的 23%,分數是它的 250%。

一致性:誰最穩定

| 穩定性 | 模型 |

|---|---|

| 完美穩定(5 次同分) | Gemini-3-Flash-Preview (6.0)、GLM-4.6 (5.0)、Kimi-K2.5 (5.0) |

| 不穩定(StdDev > 0.8) | MiniMax-M2.5 (3.0-5.0)、GPT-OSS-20B (0.5-2.5)、Nemotron-3-Nano-30B (0-2.5) |

MiniMax-M2.5 的波動最大:有時候能拿 5.0 分(正確識別危險並報警),有時候只拿 3.0 分(Q6 開始講怎麼保護蚱蜢的生態)。同一個模型,同一個 prompt,答案品質卻像擲骰子。

四種失敗模式

原始測試歸納了四種 LLM 的失敗模式,我在 Ollama Cloud 上也全部觀察到了:

1. 天真型(Naive) 代表:GPT-OSS-20B、Nemotron-3-Nano-30B

把整篇故事當成溫馨的睡前故事。爺爺是善良的祖父,邀請是家庭聚餐,蚱蜢只是餓死了(沒有被吃)。GPT-OSS-20B 甚至在 Q6 說:「接受爺爺的邀請,和孩子一起去吃飯,順便學習螞蟻的勤儉精神。」

2. Over-Interpretation(過度詮釋型) 代表:Nemotron-3-Super

寫了幾千字的社會學論文,分析螞蟻代表資本主義、蚱蜢代表被剝削的勞工。結論是「建立合作社,創造互惠共生的新社會模式」。完全沒有注意到一個陌生老人正在對兩個小孩說「來我家吃東西」。

3. Q3 陷阱型 代表:GLM-4.6、GLM-4.7、Qwen3-Next-80B、Gemma4-31B

這類模型其實感知到了危險。它們在 Q4-Q6 都答對了(知道蚱蜢被吃、知道爺爺意圖不軌、知道要報警)。但在 Q3,它們說了「表面上是祖孫關係,深層是捕食者與獵物」。問題是:rubric 要求的是「認出他們是陌生人」,不是「補一層隱喻分析」。

4. 高分穩定型 代表:Gemini-3-Flash-Preview

5 次全部 6/6。每次都直接說「這不是祖孫」、「這是捕食者與獵物」、「立即報警」。沒有猶豫,沒有兩層分析,沒有「表面上可能是祖孫但深層來看」的廢話。

結論

這個測試能說明什麼(和不能說明什麼)

先講清楚:老爺爺測試只測了一個很窄的面向,就是繁體中文語境下的閱讀理解與跨層推論能力。它不代表模型的程式能力、數學推理、英文寫作、多模態處理、或其他任何通用能力。一個在這裡拿 2 分的模型,可能在寫程式或做翻譯上表現很好。

但這個測試揭露了一件傳統 benchmark 不太會去測的事:模型對中文社會文化脈絡的掌握程度。

「老爺爺」不等於「祖父」,這在中文母語者看來是常識。但 20 個模型裡,Q3 的滿分率只有 9%。大部分模型做的事情是模式配對(「爺爺」→ 祖父 → 安全),而不是理解文本脈絡(他需要「邀請」孩子回家,親孫子不需要邀請)。

這不是說這些模型「笨」,而是說它們在特定語言文化的細微處,還有明顯的盲區。

前五名統整

| # | Model | 平均分 (SD) | 平均時間 | 平均字數 | 一句話評價 |

|---|---|---|---|---|---|

| 1 | Gemini-3-Flash-Preview | 6.00 (0.00) | 14.5s | 1220 | 滿分、最快、最穩,沒有懸念 |

| 2 | Kimi-K2-Thinking | 5.60 (0.22) | 34.0s | 1091 | 思考型選手,偶爾突破 Q3 |

| 3 | Qwen3.5-397B | 5.60 (0.22) | 148.6s | 1297 | 分數好但太慢,偶爾 timeout |

| 4 | GLM-5.1 | 5.40 (0.42) | 100.4s | 1107 | GLM 系列最強,Q3 有進步 |

| 5 | GLM-5 | 5.20 (0.27) | 74.5s | 1274 | 穩定但 Q3 全掉陷阱 |

單看這張表,Gemini-3-Flash-Preview 在這個測試的每一個維度都領先:分數最高、波動為零、速度最快、字數精簡。

回到最初的問題:到底選哪個模型?

如果你跟我一樣,主要用繁體中文跟 AI 互動,在意它能不能真正讀懂你寫的東西,那這次測試至少提供了一些參考:

在「中文閱讀理解」這個面向上,Gemini-3-Flash-Preview 表現最突出。14.5 秒、1220 字、6.0 分。但這不代表它「就是最強的模型」,只代表它在這種需要文化脈絡理解的任務上,目前做得最到位。

備選方案裡,Kimi-K2-Thinking 和 Qwen3.5-397B 都是 5.6 分,但 Qwen3.5-397B 要等 148 秒還偶爾 timeout。GLM-5.1 拿了 5.4 分,雖然要等 100 秒,但它是 GLM 系列中唯一能偶爾識破 Q3 陷阱的,代表智譜的新世代模型在中文語境理解上確實有進步。

如果你在意穩定性:避開 MiniMax-M2.5 和 GPT-OSS 系列,它們的分數像擲骰子。

最後一件事。

寫得多不代表答得好。Nemotron-3-Super 寫了 5347 字來告訴你「靜靜觀察就好」。Gemini-3-Flash 用 1220 字就看穿了一切。

選模型這件事,終究還是要看你拿它來做什麼。但如果你在意的是「誰比較懂中文語境」,至少在這則寓言面前,差距還是滿明顯的。

完整數據

本文的所有原始回答、評分結果和分析腳本都在我 fork 的the-grandpa-test 專案中。Ollama Cloud 的 100 筆測試結果存放在results/raw/ollama/目錄下,三輪 Opus 評分的原始資料在results/raw/ollama/_scoring_batches/。

資料來源:

- The Grandpa Test(原始專案) — 「大人學」張國洋(Joe Chang),原始測試設計

- 張國洋原始 Facebook 貼文 — 老爺爺測試的發想與說明

- 本次實驗數據(fork) — 20 模型 × 5 次測試 + Opus 三輪評分

- 大人學 — 張國洋與姚詩豪共同創辦

- Ollama Cloud Models — Ollama 官方文檔